ما هي قرصنة الذكاء الاصطناعي؟

اختراق الذكاء الاصطناعي هو استخدام الذكاء الاصطناعي لتعزيز أو أتمتة الهجمات الإلكترونية. وهو يسمح للجهات الفاعلة في مجال التهديد بإنشاء التعليمات البرمجية وتحليل الأنظمة والتهرب من الدفاعات بأقل جهد يدوي ممكن.

نماذج الذكاء الاصطناعي، وخاصة النماذج اللغوية الكبيرة (LLMs)، تجعل تطوير الهجمات أسرع وأرخص وأكثر سهولة في متناول القراصنة الأقل خبرة. والنتيجة هي مجموعة جديدة من هجمات الذكاء الاصطناعي الأسرع والأكثر قابلية للتطوير، وغالباً ما يكون من الصعب إيقافها باستخدام الدفاعات التقليدية.

ما هو مخترق الذكاء الاصطناعي؟

قرصان الذكاء الاصطناعي هو فاعل تهديد يستخدم الذكاء الاصطناعي لأتمتة الهجمات الإلكترونية أو تعزيزها أو توسيع نطاقها. يستخدم قراصنة الذكاء الاصطناعي نماذج التعلم الآلي والذكاء الاصطناعي التوليدي والوكلاء المستقلين لتجاوز الضوابط الأمنية، وصياغة هجمات تصيد احتيالي مقنعة للغاية، واستغلال الثغرات البرمجية على نطاق واسع.

يمكن أن يشمل هؤلاء المهاجمون كلاً أدوات المشغلين البشريين أدوات يستخدمون أدوات الذكاء الاصطناعي والأنظمة شبه المستقلة التي تنفذ المهام بأدنى حد من التدخل البشري. المهاجمون البشريون الذين يستخدمون الذكاء الاصطناعي هم أفراد حقيقيون — مجرمون، أو قراصنة مبتدئون، أو ناشطون إلكترونيون، أو جهات فاعلة تابعة لدول — يستخدمون نماذج الذكاء الاصطناعي لتعزيز قدراتهم الهجومية.

وكلاء القرصنة المستقلون هم سير عمل مدعوم بالذكاء الاصطناعي يمكنه ربط المهام — مثل الاستطلاع وتوليد الحمولة والتهرب — بأقل قدر من الإشراف. على الرغم من أن هؤلاء الوكلاء لا يزالون يتبعون أهدافًا حددها البشر، إلا أنهم يمكنهم العمل بشكل شبه مستقل بمجرد إطلاقهم، وتنفيذ هجمات متعددة الخطوات بكفاءة أكبر من أدوات اليدوية.

كيف يُستخدم الذكاء الاصطناعي في الجرائم السيبرانية؟

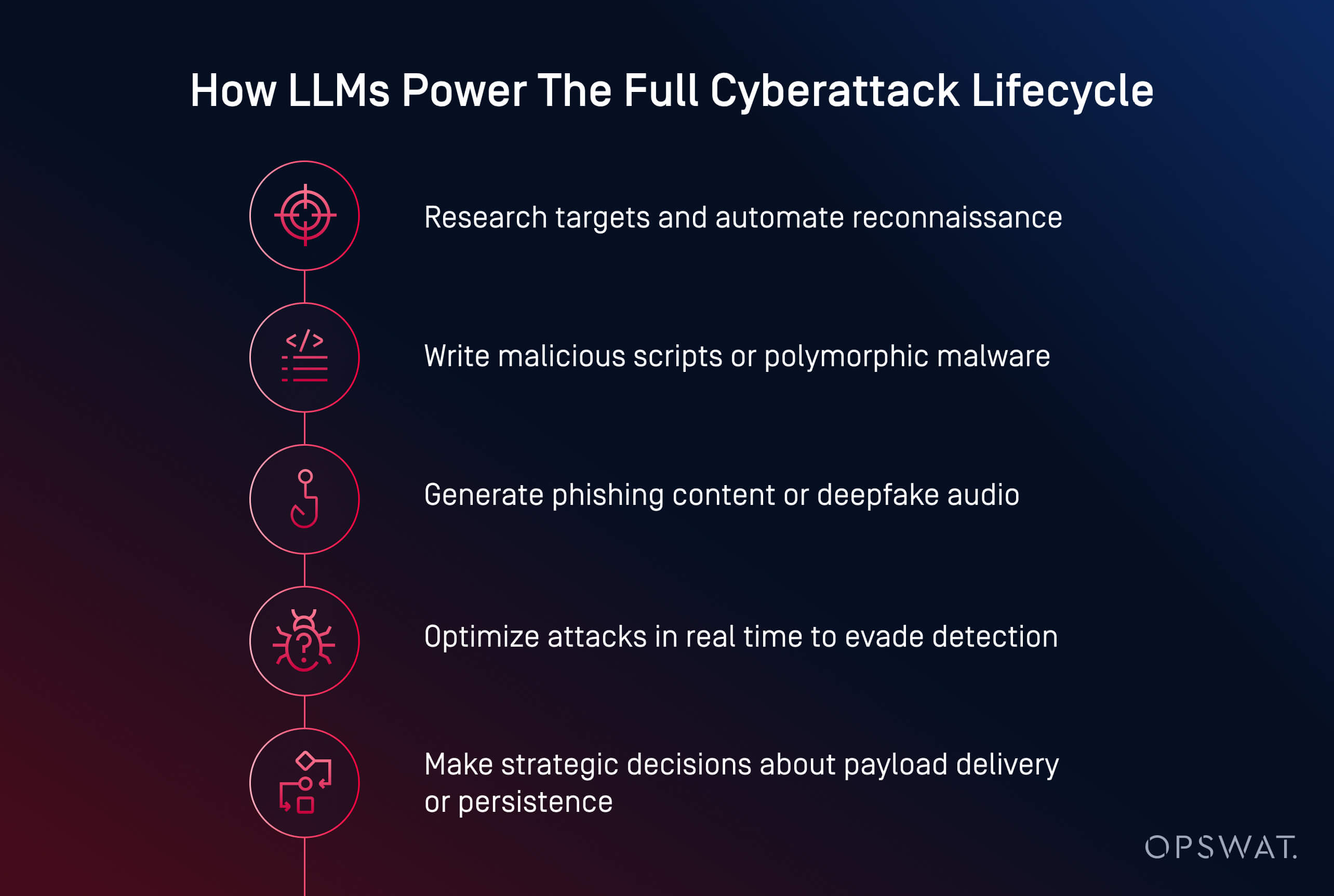

تستخدم الجهات الفاعلة في مجال التهديد بالذكاء الاصطناعي الآن الذكاء الاصطناعي لشن هجمات إلكترونية أسرع وأكثر ذكاءً وتكيّفاً. من إنشاء البرمجيات الخبيثة إلى أتمتة التصيّد الاحتيالي، يعمل الذكاء الاصطناعي على تحويل الجريمة الإلكترونية إلى عملية قابلة للتطوير. ويمكنه الآن إنشاء التعليمات البرمجية الخبيثة، وكتابة محتوى تصيد احتيالي مقنع، وحتى توجيه المهاجمين من خلال سلاسل هجمات كاملة.

يستخدم مجرمو الإنترنت الذكاء الاصطناعي في عدة مجالات أساسية:

- توليد الحمولة: يمكن لأ أدوات HackerGPT و WormGPT كتابة برامج ضارة مشوشة، وأتمتة تكتيكات التهرب، وتحويل البرامج النصية إلى ملفات قابلة للتنفيذ. هذه أمثلة على هجمات الذكاء الاصطناعي التوليدي، والتي غالبًا ما تظهر في الهجمات الإلكترونية التي يشنها وكلاء الذكاء الاصطناعي حيث تتخذ النماذج قرارات مستقلة.

- الهندسة الاجتماعية: ينشئ الذكاء الاصطناعي رسائل بريد إلكتروني واقعية للتصيد الاحتيالي، ويستنسخ الأصوات، ويولد رسائل مزيفة عميقة للتلاعب بالضحايا بشكل أكثر فعالية.

- الاستطلاع والتخطيط: يعمل الذكاء الاصطناعي على تسريع البحث عن الأهداف ورسم خرائط البنية التحتية وتحديد نقاط الضعف.

- الأتمتة على نطاق واسع: يستخدم المهاجمون الذكاء الاصطناعي لشن حملات متعددة المراحل بأقل قدر من المدخلات البشرية.

ووفقًا لمعهد بونيمون، فقد تم استخدام الذكاء الاصطناعي بالفعل في حملات طلب الفدية وهجمات التصيد الاحتيالي التي تسببت في حدوث اضطرابات تشغيلية كبيرة، بما في ذلك سرقة بيانات الاعتماد والإغلاق القسري لأكثر من 300 موقع بيع بالتجزئة خلال اختراق عام 2023.

هناك العديد من الأنماط الناشئة التي تعيد تشكيل مشهد التهديدات:

- إضفاء الطابع الديمقراطي على الهجمات الإلكترونية: أصبحت النماذج مفتوحة المصدر مثل LLaMA، التي تم ضبطها بدقة من أجل الهجوم، متاحة الآن لأي شخص لديه قوة حوسبة محلية

- انخفاض عائق الدخول: ما كان يتطلب في السابق مهارات خبيرة يمكن الآن القيام به من خلال مطالبات بسيطة وبضع نقرات

- زيادة نجاح التهرب من الكشف: تتفوق البرمجيات الخبيثة التي يولدها الذكاء الاصطناعي في الاختباء من الاكتشاف الثابت وصناديق الحماية وحتى التحليل الديناميكي

- نماذج البرمجيات الخبيثة كخدمة (MaaS): يقوم المجرمون الإلكترونيون بتجميع قدرات الذكاء الاصطناعي في مجموعات برمجيات قائمة على الاشتراك، مما يسهل شن هجمات معقدة على نطاق واسع

- استخدام الذكاء الاصطناعي في الاختراقات في العالم الحقيقي: يشير معهد بونيمون إلى أن المهاجمين استخدموا بالفعل الذكاء الاصطناعي لأتمتة استهداف برمجيات الفدية، بما في ذلك في الحوادث التي أدت إلى إغلاق عمليات كبرى

التصيد الاحتيالي والهندسة الاجتماعية المدعومة بالذكاء الاصطناعي

يعمل التصيد الاحتيالي المدعوم بالذكاء الاصطناعي والهندسة الاجتماعية باستخدام الذكاء الاصطناعي على تحويل عمليات الاحتيال التقليدية إلى هجمات شخصية قابلة للتطوير ويصعب اكتشافها. تستخدم الجهات التخريبية الآن نماذج توليدية لصياغة رسائل بريد إلكتروني قابلة للتصديق، واستنساخ الأصوات، وحتى إنتاج مكالمات فيديو مزيفة للتلاعب بأهدافها.

على عكس الحيل التقليدية، فإن رسائل البريد الإلكتروني الاحتيالية التي يتم إنشاؤها بواسطة الذكاء الاصطناعي تكون مصقولة ومقنعة. أدوات ChatGPT و WormGPT تنتج رسائل تحاكي الاتصالات الداخلية أو خدمة العملاء أو تحديثات الموارد البشرية. عند اقترانها بالبيانات المخترقة، تصبح هذه الرسائل الإلكترونية مخصصة وأكثر احتمالاً للنجاح.

يعمل الذكاء الاصطناعي أيضًا على تشغيل أشكال جديدة من الهندسة الاجتماعية:

- هجمات استنساخ الصوت تحاكي المديرين التنفيذيين باستخدام عينات صوتية قصيرة لتحفيز إجراءات عاجلة مثل التحويلات البنكية

- هجمات "ديبفيك" تحاكي مكالمات الفيديو أو الاجتماعات عن بُعد من أجل عمليات احتيال عالية المخاطر

في حادثة وقعت مؤخرًا، استخدم المهاجمون رسائل البريد الإلكتروني التي تم إنشاؤها بواسطة الذكاء الاصطناعي خلال فترة التسجيل في المزايا، متظاهرين بأنهم من قسم الموارد البشرية لسرقة بيانات الاعتماد والوصول إلى سجلات الموظفين. يكمن الخطر في وهم الثقة. فعندما يبدو البريد الإلكتروني داخلياً، ويبدو الصوت مألوفاً، ويبدو الطلب ملحاً، يمكن خداع حتى الموظفين المدربين.

اكتشاف ثغرات الذكاء الاصطناعي واستغلالها

يعمل الذكاء الاصطناعي على تسريع كيفية عثور المهاجمين على الثغرات البرمجية واستغلالها. ما كان يستغرق أياماً من الاستكشاف اليدوي يمكن الآن القيام به في دقائق باستخدام نماذج التعلم الآلي المدربة على الاستطلاع وتوليد الثغرات.

يستخدم المهاجمون الذكاء الاصطناعي لأتمتة فحص الثغرات الأمنية في الأنظمة العامة، وتحديد التكوينات الضعيفة والبرامج القديمة أو الثغرات الأمنية التي لم يتم إصلاحها. على عكس أدوات التقليدية، يمكن للذكاء الاصطناعي تقييم سياق التعرض للمخاطر لمساعدة المهاجمين على تحديد أولويات الأهداف عالية القيمة.

تشمل تكتيكات الاستغلال الشائعة بمساعدة الذكاء الاصطناعي ما يلي:

- التشويش الآلي للكشف عن ثغرات يوم الصفر بشكل أسرع

- إنشاء برنامج نصي مخصص لتنفيذ التعليمات البرمجية عن بُعد أو الحركة الجانبية

- اختراق كلمات المرور وهجمات القوة الغاشمة المحسّنة من خلال تعلم الأنماط والنماذج الاحتمالية

- روبوتات الاستطلاع التي تفحص الشبكات بحثًا عن الأصول عالية الخطورة بأقل قدر من التشويش

يمكن ضبط النماذج التوليدية مثل LLaMA أو Mistral أو Gemma لتوليد حمولات مصممة خصيصاً، مثل الرموز البرمجية القشرية أو هجمات الحقن، استناداً إلى سمات خاصة بالنظام، وغالباً ما تتجاوز الضمانات المضمنة في النماذج التجارية.

الاتجاه واضح: يمكّن الذكاء الاصطناعي المهاجمين من اكتشاف الثغرات الأمنية والعمل عليها بسرعة الآلة. ووفقاً لمعهد بونيمون، فإن 54% من المتخصصين في الأمن السيبراني يصنفون الثغرات التي لم يتم إصلاحها على أنها مصدر قلقهم الأكبر في عصر الهجمات المدعومة بالذكاء الاصطناعي.

البرمجيات الخبيثة وفيروسات الفدية الخبيثة المعتمدة على الذكاء الاصطناعي

ظهور البرامج الضارة التي يتم إنشاؤها بواسطة الذكاء الاصطناعي يعني أن الدفاعات التقليدية وحدها لم تعد كافية. أصبح لدى المهاجمين الآن أدوات التفكير والتكيف والتهرب، وغالبًا ما تكون أسرع من قدرة المدافعين البشريين على الاستجابة.

تُعيد برمجيات الفدية الخبيثة والبرمجيات الخبيثة متعددة الأشكال المدعومة بالذكاء الاصطناعي تعريف كيفية تطور الهجمات الإلكترونية. فبدلاً من كتابة الحمولات الثابتة، يستخدم المهاجمون الآن الذكاء الاصطناعي لإنشاء برمجيات خبيثة متعددة الأشكال - وهي برمجيات خبيثة تتغير باستمرار لتجنب اكتشافها.

تتطور تهديدات برامج الفدية الخبيثة أيضًا. يمكن أن يساعد الذكاء الاصطناعي في اختيار الملفات المراد تشفيرها، وتحليل قيمة النظام، وتحديد التوقيت الأمثل للتفجير. كما يمكن لهذه النماذج أيضاً أتمتة السياج الجغرافي، والتهرب من وضع الحماية والتنفيذ في الذاكرة، وهي تقنيات تستخدمها عادةً الجهات الفاعلة في مجال التهديدات المتقدمة.

يتكيف استخراج البيانات باستخدام الذكاء الاصطناعي بشكل ديناميكي لتجنب الاكتشاف. يمكن للخوارزميات ضغط البيانات وتشفيرها واستخراجها خلسةً من خلال تحليل أنماط حركة البيانات، وتجنب مشغلات الكشف. بدأ بعض وكلاء البرمجيات الخبيثة في اتخاذ قرارات استراتيجية: اختيار متى وأين وكيف يتم الاستخراج بناءً على ما يلاحظونه داخل البيئة المخترقة.

أمثلة على الهجمات الإلكترونية للذكاء الاصطناعي

لم تعد هجمات الذكاء الاصطناعي السيبراني نظرية؛ فقد تم استخدامها بالفعل لسرقة البيانات وتجاوز الدفاعات وانتحال شخصية البشر على نطاق واسع.

تُظهر الأمثلة في الفئات الثلاث البارزة أدناه أن المهاجمين لم يعودوا بحاجة إلى مهارات متقدمة لإحداث أضرار جسيمة في الهجمات الإلكترونية. يقلل الذكاء الاصطناعي من عائق الدخول مع زيادة سرعة الهجوم ونطاقه والتخفي. يجب على المدافعين التكيف من خلال اختبار الأنظمة المدمجة بالذكاء الاصطناعي بشكل استباقي ونشر الضمانات التي تأخذ في الحسبان التلاعب التقني والخداع البشري.

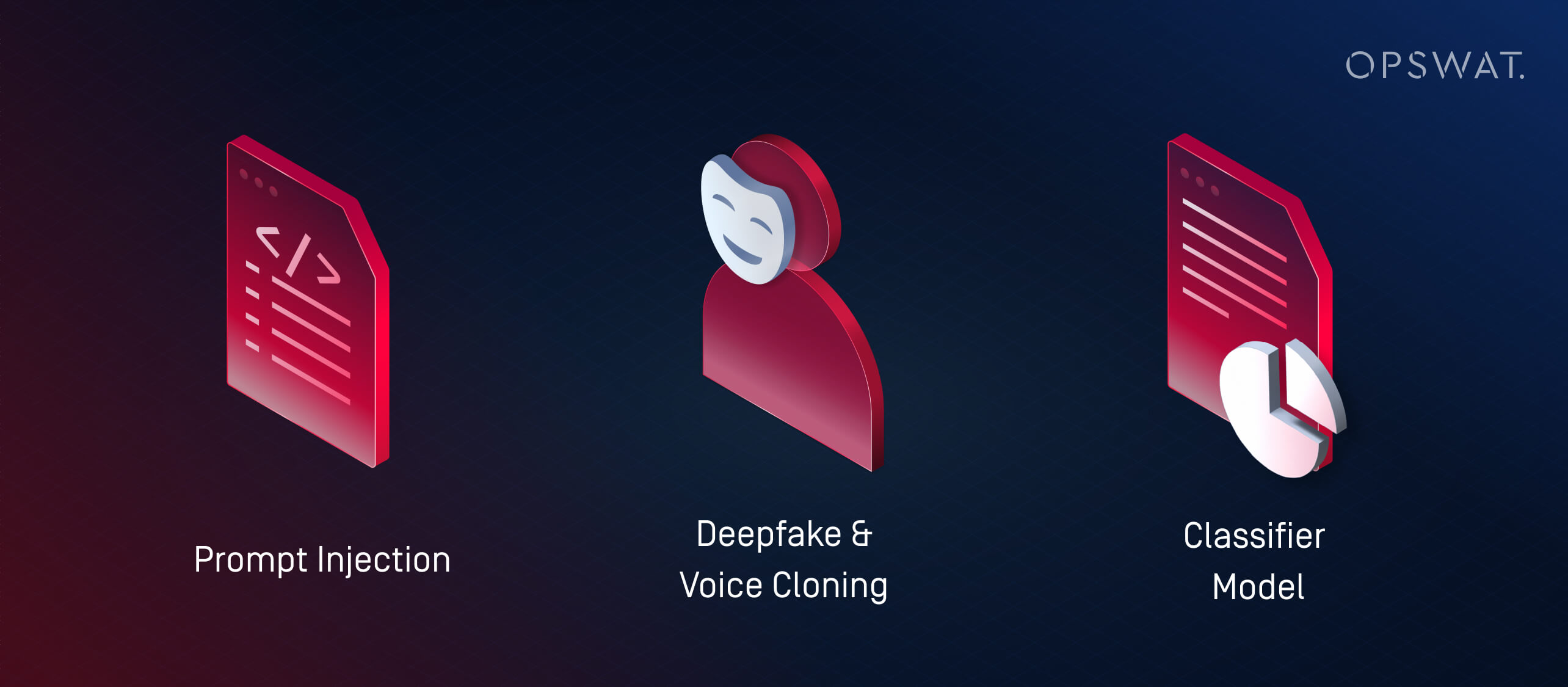

1. ما هي هجمات الحقن الموجه؟

الحقن الموجه هو أسلوب يستغل فيه المهاجمون الثغرات في نماذج اللغات الكبيرة (LLMs) من خلال تزويدها بمدخلات مصممة خصيصًا لتجاوز السلوك المقصود. تستغل هذه الهجمات الطريقة التي تفسر بها نماذج اللغات الكبيرة (LLMs) التعليمات وتحدد أولوياتها، وغالبًا ما يكون ذلك بدون برمجيات خبيثة تقليدية أو بالقليل منها.

بدلاً من استخدام الذكاء الاصطناعي لشن هجمات خارجية، فإن الحقن الفوري يحول أنظمة الذكاء الاصطناعي الخاصة بالمؤسسة إلى عوامل تهديد غير مقصودة. إذا تم تضمين LLM في أدوات مكاتب المساعدة أو روبوتات الدردشة أو معالجات المستندات دون ضمانات مناسبة، يمكن للمهاجم تضمين أوامر مخفية يقوم النموذج بتفسيرها وتنفيذها. وقد يؤدي ذلك إلى:

- تسريب البيانات الخاصة أو المقيدة

- تنفيذ إجراءات غير مقصودة (مثل إرسال رسائل البريد الإلكتروني، وتغيير السجلات)

- التلاعب بالمخرجات لنشر معلومات مضللة أو تحفيز إجراءات المتابعة

تتصاعد هذه المخاطر في الأنظمة التي تمرر فيها نماذج متعددة المعلومات بين بعضها البعض. على سبيل المثال، يمكن أن تؤثر مطالبة خبيثة مضمنة في مستند ما على مُلخِّص الذكاء الاصطناعي، الذي يمرر بعد ذلك رؤى معيبة إلى الأنظمة النهائية.

ومع ازدياد دمج الذكاء الاصطناعي في تدفقات العمل التجاري، يستهدف المهاجمون هذه النماذج بشكل متزايد لاختراق الثقة أو استخراج البيانات أو التلاعب بالقرارات من الداخل إلى الخارج.

2. ما هي هجمات التزييف العميق والاستنساخ الصوتي؟

تستخدم هجمات Deepfake الصوت أو الفيديو الذي تم إنشاؤه بواسطة الذكاء الاصطناعي لتقليد الأشخاص في الوقت الفعلي. إلى جانب أساليب الهندسة الاجتماعية، أدوات هذه أدوات في عمليات الاحتيال وسرقة بيانات الاعتماد والوصول غير المصرح به إلى الأنظمة.

أصبح استنساخ الصوت خطيراً بشكل خاص. فمن خلال بضع ثوانٍ فقط من الكلام المسجّل، يمكن لممثلي التهديد توليد صوت يحاكي نبرة الصوت ووتيرة الصوت والانعطاف. ثم تُستخدم هذه الأصوات المستنسخة في:

- انتحال شخصية المديرين التنفيذيين أو المديرين أثناء المكالمات العاجلة

- خداع الموظفين في التحويلات البرقية أو إعادة تعيين كلمة المرور

- تجاوز أنظمة المصادقة الصوتية

تأخذ عمليات التزييف العميق هذا الأمر خطوة أخرى إلى الأمام من خلال توليد مقاطع فيديو اصطناعية. يمكن لجهات التهديد محاكاة مدير تنفيذي في مكالمة فيديو يطلب بيانات سرية - أو الظهور في مقاطع مسجلة "تعلن" عن تغييرات في السياسة التي تنشر معلومات مضللة. وقد أبلغ معهد بونيمون عن حادثة استخدم فيها المهاجمون رسائل مولدة بالذكاء الاصطناعي منتحلين صفة الموارد البشرية خلال فترة تسجيل المزايا في إحدى الشركات مما أدى إلى سرقة بيانات الاعتماد.

مع أدوات إمكانية الوصول إلى أدوات الذكاء الاصطناعي، أدوات بإمكان حتى الفاعلين الصغار توليد انتحالات عالية الدقة. تتجاوز هذه الهجمات مرشحات البريد العشوائي التقليدية أو دفاعات نقاط النهاية من خلال استغلال الثقة.

3. ما هي هجمات نموذج المصنف (التعلم الآلي العدائي)؟

تتلاعب هجمات نماذج المصنفات بمدخلات أو سلوك نظام الذكاء الاصطناعي لفرض قرارات غير صحيحة دون الحاجة إلى كتابة برمجيات خبيثة أو استغلال التعليمات البرمجية. تندرج هذه التكتيكات تحت الفئة الأوسع للتعلم الآلي العدائي.

هناك استراتيجيتان أساسيتان أساسيتان:

- هجمات المراوغة: يقوم المهاجم بصياغة مدخلات تخدع المصنف ليخطئ في التعرف عليها، مثل البرمجيات الخبيثة التي تحاكي ملفات غير ضارة لتجاوز محركات مكافحة الفيروسات

- هجمات التسميم: يتم تدريب النموذج أو ضبطه على بيانات مشوهة عمدًا، مما يغير قدرته على اكتشاف التهديدات

غالبًا ما تكون النماذج الخاضعة للإشراف "مفرطة في التكيف": فهي تتعلم أنماطًا محددة من بيانات التدريب وتفوت الهجمات التي تنحرف قليلاً عن هذه الأنماط. يستغل المهاجمون هذا الأمر باستخدام أدوات WormGPT (نموذج لغة كبير مفتوح المصدر تم ضبطه بدقة لأداء المهام الهجومية) لإنشاء حمولات خارج حدود الكشف المعروفة.

هذه هي نسخة التعلم الآلي من ثغرة يوم الصفر.

قرصنة الذكاء الاصطناعي مقابل القرصنة التقليدية: الاختلافات الرئيسية

يستخدم قراصنة الذكاء الاصطناعي الذكاء الاصطناعي لأتمتة الهجمات الإلكترونية باستخدام الذكاء الاصطناعي وتعزيزها وتوسيع نطاقها. وعلى النقيض من ذلك، غالبًا ما يتطلب الاختراق التقليدي برمجة يدوية وخبرة تقنية عميقة واستثمارًا كبيرًا للوقت. ويكمن الفرق الأساسي في السرعة وقابلية التوسع وسهولة الوصول: حتى المهاجمين المبتدئين يمكنهم الآن شن هجمات إلكترونية متطورة مدعومة بالذكاء الاصطناعي باستخدام بعض المطالبات ووحدة معالجة رسومات من فئة المستهلك.

أسبكت | اختراق الذكاء الاصطناعي | القرصنة التقليدية |

|---|---|---|

السرعة | شبه فوري مع الأتمتة | بطء في البرمجة النصية اليدوية |

متطلبات المهارة | قائم على الموجه؛ حاجز منخفض للدخول، ولكنه يتطلب الوصول إلى النموذج وضبطه | عالية؛ تتطلب خبرة فنية عميقة |

قابلية التوسع | عالية - تدعم الهجمات متعددة المراحل عبر العديد من الأهداف | محدودة بالوقت والجهد البشري |

القدرة على التكيف | ديناميكي - يقوم الذكاء الاصطناعي بتعديل الحمولات والمراوغة في الوقت الفعلي | البرامج النصية الثابتة أو شبه القابلة للتكيف |

نواقل الهجوم | نماذج التزييف العميق، والتزييف العميق، وهجمات نماذج التصنيف، والوكلاء المستقلون | البرمجيات الخبيثة، والتصيّد الاحتيالي، والاستطلاع اليدوي وعمليات الاستغلال |

المحاذير | يمكن أن تكون غير متوقعة؛ تفتقر إلى النية والسياق دون إشراف بشري | تحكم أكثر استراتيجية، ولكن أبطأ ويدويًا |

إساءة استخدام الذكاء الاصطناعي والتعلم الآلي العدائي

لا تتضمن جميع تهديدات الذكاء الاصطناعي توليد برمجيات خبيثة - فبعضها يستهدف أنظمة الذكاء الاصطناعي نفسها. يمكن لتكتيكات التعلّم الآلي العدائية مثل الحقن الفوري وتسميم النماذج أن تتلاعب بالمصنفات أو تتجاوز الكشف أو تفسد عملية اتخاذ القرار. ونظراً لأن الذكاء الاصطناعي أصبح محورياً في سير العمل الأمني، فإن هذه الهجمات تسلط الضوء على الحاجة الملحة لإجراء اختبارات قوية وإشراف بشري.

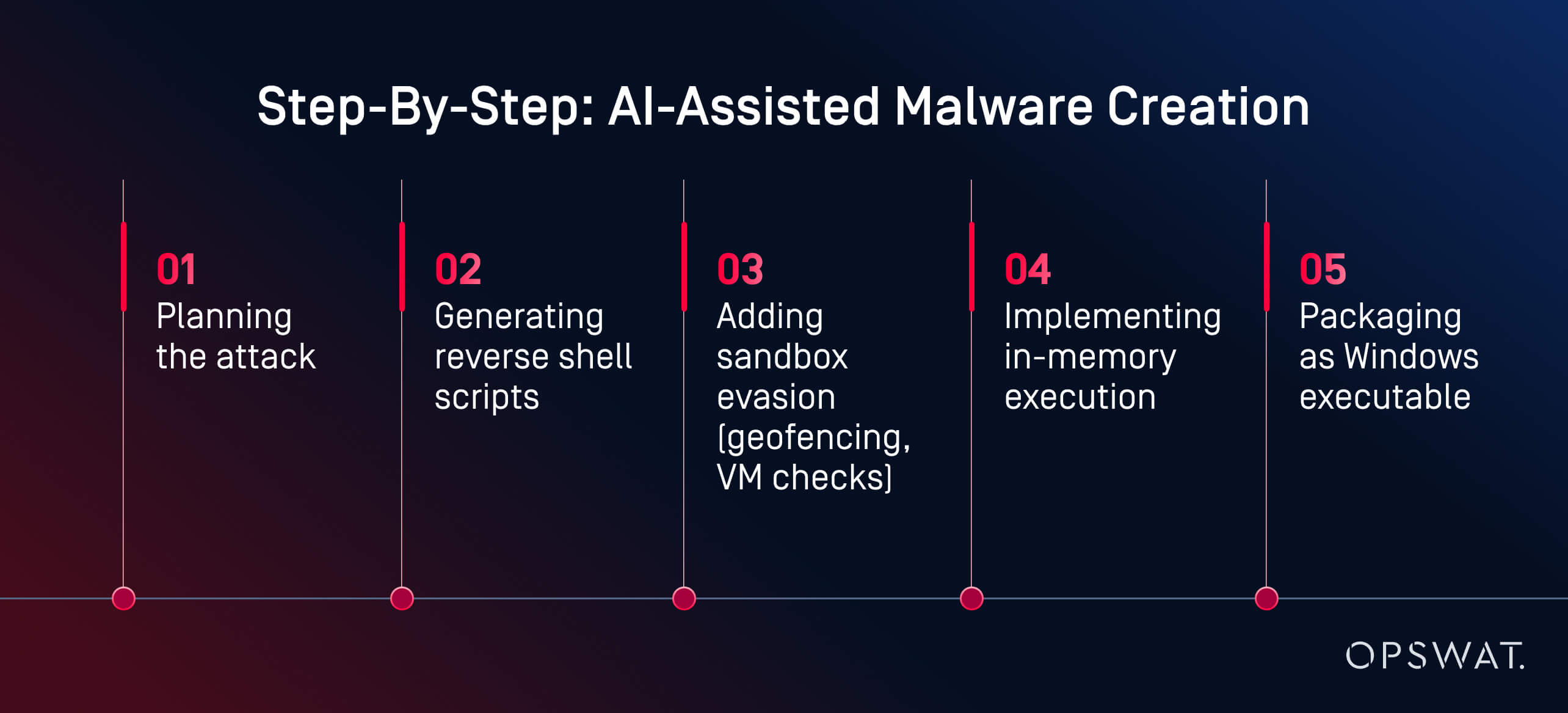

كيف يمكن إساءة استخدام الذكاء الاصطناعي لتطوير البرمجيات الخبيثة: تحليل خبراء OPSWAT

ما كان يتطلب مهارات متقدمة في السابق يتطلب الآن مطالبات وبضع نقرات.

في تجربة حية، أظهر خبيرOPSWAT مارتن كالاس كيف أدوات استخدام أدوات الذكاء الاصطناعي لإنشاء برامج ضارة مراوغة بسرعة وبتكلفة منخفضة ودون الحاجة إلى مهارات متقدمة. باستخدام HackerGPT، أنشأ مارتن سلسلة كاملة من البرامج الضارة في أقل من ساعتين. وقد أرشده النموذج خلال كل مرحلة:

وأوضح مارتن: "لقد أرشدني الذكاء الاصطناعي خلال كل مرحلة: التخطيط، والتشويش، والتهرب، والتنفيذ". والنتيجة كانت "... حمولة تم إنشاؤها بواسطة الذكاء الاصطناعي والتي تهربت من اكتشافها من قبل 60 من أصل 63 محركًا لمكافحة الفيروسات على موقع VirusTotal." كما فشل التحليل السلوكي وصندوق الرمل في الإبلاغ عن أنها خبيثة.

لم تكن هذه دولة قومية. لم يكن هذا مخترقًا سيئًا. كان محللًا متحمسًا يستخدم أدوات متاحة للجمهور أدوات وحدة معالجة رسومات (GPU) مخصصة للمستهلكين. العامل الرئيسي الذي مكنه من ذلك؟ نماذج الذكاء الاصطناعي غير المقيدة والمستضافة محليًا. مع وجود أكثر من مليون نموذج مفتوح المصدر متاح على منصات مثل Hugging Face، يمكن للمهاجمين الاختيار من مكتبة واسعة، وضبطها لأغراض خبيثة، وتشغيلها دون رقابة. على عكس الخدمات المستندة إلى السحابة، يمكن إعادة برمجة نماذج LLM المحلية لتجاهل الإجراءات الوقائية وتنفيذ مهام هجومية.

"هذا ما يمكن أن يبنيه هاوٍ متحمس. تخيل ما يمكن أن تفعله دولة قومية"، حذر مارتن. ويوضح مثاله كيف يمكن لإساءة استخدام الذكاء الاصطناعي أن تحول الجرائم الإلكترونية من مهنة تتطلب مهارة إلى عملية سهلة المنال ومدعومة بالذكاء الاصطناعي. اليوم، لم يعد إنشاء البرمجيات الخبيثة عقبة. يجب أن يتطور الكشف عن البرمجيات الخبيثة بسرعة أكبر من أدوات التي يمتلكها أدوات الآن.

كيفية الدفاع ضد الهجمات الإلكترونية المدعومة بالذكاء الاصطناعي

نحتاج إلى دفاع متعدد الطبقات - وليس مجرد كشف أكثر ذكاءً.

يتطلب الدفاع عن الأنظمة ضد الهجمات الإلكترونية المدعومة بالذكاء الاصطناعي استراتيجية متعددة الطبقات تجمع بين الأتمتة والبصيرة البشرية، والوقاية والكشف. تدمج حلول الأمن السيبراني الرائدة المدعومة بالذكاء الاصطناعي، حلول منصة OPSWATالمتقدمة للوقاية من التهديدات، بين الوقاية والكشف. شاهد الفيديو لمعرفة المزيد.

اختبار أمان الذكاء الاصطناعي والفريق الأحمر

تلجأ العديد من المؤسسات إلى المحاكاة الجماعية الحمراء بمساعدة الذكاء الاصطناعي لاختبار دفاعاتها ضد إساءة استخدام LLM، والحقن الفوري، والتهرب من المصنفات. تساعد عمليات المحاكاة هذه في الكشف عن نقاط الضعف في الأنظمة المدمجة بالذكاء الاصطناعي قبل أن يكتشفها المهاجمون.

تستخدم الفرق الحمراء المطالبات العدائية، والتصيد الاحتيالي الاصطناعي، والحمولات التي يولدها الذكاء الاصطناعي لتقييم ما إذا كانت الأنظمة مرنة أو قابلة للاستغلال. يتضمن اختبار أمان الذكاء الاصطناعي أيضاً:

- نماذج التشويش على مخاطر الحقن الفوري

- تقييم كيفية تعامل الآلات ذات السلاسل الطويلة الأجل مع المدخلات المتلاعبة أو المتسلسلة

- اختبار متانة المصنف في مواجهة السلوك المراوغ

كما بدأ قادة الأمن أيضاً في فحص أجهزة LLM الخاصة بهم بحثاً عن التسريبات الفورية أو الهلوسة أو الوصول غير المقصود إلى المنطق الداخلي، وهي خطوة حاسمة مع دمج الذكاء الاصطناعي التوليدي في المنتجات وسير العمل.

مكدس دفاعي أكثر ذكاءً: نهج OPSWAT

بدلاً من محاولة "محاربة الذكاء الاصطناعي بالذكاء الاصطناعي" في حلقة رد فعلية، يدعو مارتن كالاس إلى اتباع دفاع استباقي متعدد المستويات.حلول OPSWAT حلول التقنيات التي تستهدف دورة حياة التهديد بالكامل:

- Metascan™ Multiscanning: يقوم بتشغيل الملفات من خلال محركات متعددة لمكافحة الفيروسات لاكتشاف التهديدات التي لا تلتقطها أنظمة محرك واحد لمكافحة الفيروسات

- MetaDefender : يحلل سلوك الملفات في بيئات معزولة، حتى أنه يكتشف الحمولات التي تم إنشاؤها بواسطة الذكاء الاصطناعي والتي تتجنب القواعد الثابتة.

- تقنية Deep CDR™: تحيد التهديدات عن طريق إعادة بناء الملفات إلى إصدارات آمنة، وإزالة الثغرات الأمنية المضمنة

تم تصميم هذه المجموعة الأمنية متعددة الطبقات لمواجهة الطبيعة غير المتوقعة للبرامج الضارة التي تولدها الذكاء الاصطناعي، بما في ذلك التهديدات متعددة الأشكال، والحمولات في الذاكرة، والإغراءات المزيفة التي تتجاوز أدوات التقليدية. ونظرًا لأن كل طبقة تستهدف مرحلة مختلفة من سلسلة الهجوم، فإنه لا يتطلب سوى طبقة واحدة لاكتشاف التهديد أو تحييده وإحباط العملية برمتها قبل أن تحدث أي أضرار.

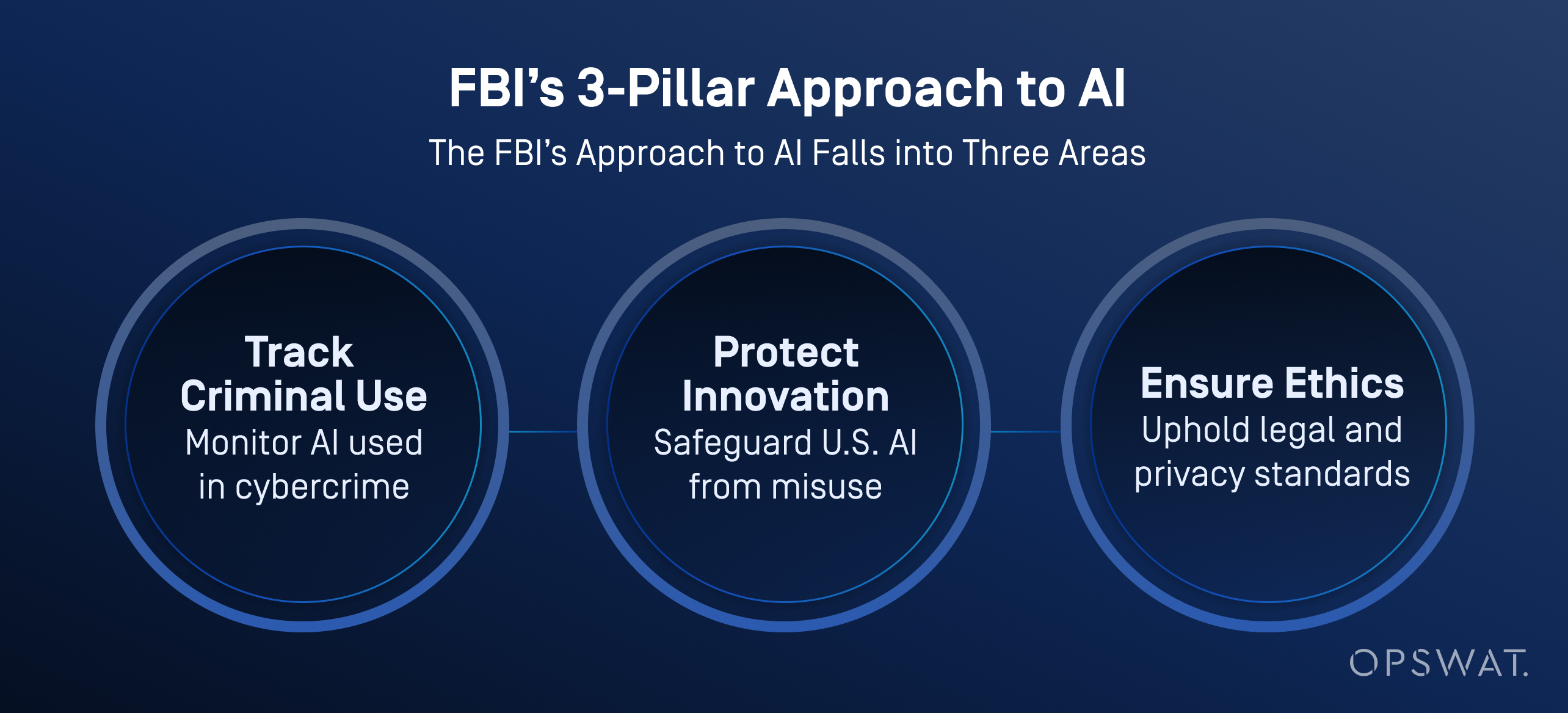

حالات استخدام الصناعة: ما هو الذكاء الاصطناعي الذي يستخدمه مكتب التحقيقات الفيدرالي؟

يقوم مكتب التحقيقات الفيدرالي والوكالات الأمريكية الأخرى بدمج الذكاء الاصطناعي بشكل متزايد في عمليات الدفاع السيبراني الخاصة بهم ليس فقط لفرز التهديدات وترتيب أولوياتها، ولكن أيضًا لتعزيز تحليل البيانات وتحليلات الفيديو والتعرف على الصوت.

ووفقًا لمكتب التحقيقات الفيدرالي، يساعد الذكاء الاصطناعي في معالجة كميات كبيرة من البيانات لتوليد خيوط التحقيق، بما في ذلك التعرف على المركبات، وتحديد اللغة، وتحويل الكلام إلى نص. والأهم من ذلك، يفرض المكتب إشرافًا بشريًا صارمًا: يجب التحقق من جميع المخرجات التي يولدها الذكاء الاصطناعي من قبل محققين مدربين قبل اتخاذ أي إجراء.

الذكاء الاصطناعي ليس بديلاً عن اتخاذ القرارات البشرية. يشدد مكتب التحقيقات الفيدرالي على أن الإنسان مسؤول دائمًا عن نتائج التحقيقات، وأن الذكاء الاصطناعي يجب أن يُستخدم بطريقة تحترم الخصوصية والحريات المدنية والمعايير القانونية.

هل المنظمات جاهزة؟

على الرغم من ارتفاع التهديدات التي يحركها الذكاء الاصطناعي، يقول 37% فقط من المتخصصين في مجال الأمن أنهم يشعرون بأنهم مستعدون لوقف هجوم إلكتروني مدعوم بالذكاء الاصطناعي، كما جاء في تقرير حالة الأمن السيبراني للذكاء الاصطناعي الصادر عن شركة Ponemon. لا يزال الكثيرون يعتمدون على خطط إدارة المخاطر الإلكترونية القديمة واستراتيجيات الكشف التفاعلي.

يتطلب الطريق إلى الأمام 4 خطوات أساسية

- اعتماد أسرع أدوات الدفاع المدركة للذكاء الاصطناعي

- الفريق الأحمر المستمر والاختبار الفوري للمخاطر

- الاستخدام الفعال Multiscanning والتخزين المضغوط ووضع الحماية

- تدريب محللي SOC على العمل جنبًا إلى جنب مع أدوات التحقيق الآلية

لقد غيرت الذكاء الاصطناعي القواعد. لا يتعلق الأمر باستبدال البشر، بل بتزويدهم أدوات غلب أدوات الهجمات التي أصبحت الآن قادرة على التفكير بنفسها. اكتشف كيف تساعد منصتنا في تأمين الملفات والأجهزة وتدفق البيانات عبر بيئات تكنولوجيا المعلومات وتكنولوجيا التشغيل.

الأسئلة الشائعة (FAQs)

ما هي قرصنة الذكاء الاصطناعي؟

القرصنة باستخدام الذكاء الاصطناعي هي استخدام أدوات نماذج اللغة الكبيرة (LLMs) لأتمتة الهجمات الإلكترونية أو تعزيزها. وهي تساعد المهاجمين على إنشاء برامج ضارة، وشن حملات تصيد احتيالي، وتجاوز الدفاعات بشكل أسرع وأسهل من ذي قبل.

كيف يُستخدم الذكاء الاصطناعي في الجرائم الإلكترونية؟

يستخدم المجرمون الذكاء الاصطناعي لإنشاء برامج ضارة وأتمتة عمليات التصيد الاحتيالي وتسريع عمليات فحص الثغرات الأمنية. بعض أدوات تلك التي تباع في منتديات الويب المظلم يمكنها حتى توجيه المهاجمين خلال سلاسل الهجوم الكاملة.

ما الفرق بين قرصنة الذكاء الاصطناعي والقرصنة التقليدية؟

تتطلب القرصنة التقليدية ترميزاً عملياً واستخدام الأدوات والمهارات التقنية. تقلل قرصنة الذكاء الاصطناعي من هذا العائق من خلال النماذج التي تولد الحمولات والبرامج النصية ومحتوى التصيد الاحتيالي من مطالبات بسيطة. هذه التقنيات تجعل الهجمات أسرع وأكثر قابلية للتطوير وفي متناول الهواة.

كيف يمكن إساءة استخدام الذكاء الاصطناعي لتطوير البرمجيات الخبيثة؟

يمكن للذكاء الاصطناعي توليد برمجيات خبيثة متعددة الأشكال، وقذائف عكسية وحمولات خبيثة في صندوق الرمل مع القليل من المدخلات. كما هو موضح في عرض توضيحي مباشر OPSWAT أنشأ مستخدم غير خبيث برمجيات خبيثة شبه معدومة في أقل من ساعتين باستخدام نماذج ذكاء اصطناعي مفتوحة المصدر تعمل على حاسوب ألعاب.

هل يمكن للذكاء الاصطناعي أن يحل محل القراصنة؟

ليس بعد، ولكن يمكنه التعامل مع العديد من المهام التقنية. لا يزال القراصنة يختارون الأهداف والأهداف، بينما يقوم الذكاء الاصطناعي بكتابة التعليمات البرمجية والتهرب من الاكتشاف وتكييف الهجمات. الخطر الحقيقي يكمن في المهاجمين البشريين الذين تضخمهم سرعة الذكاء الاصطناعي.

ما هو مخترق الذكاء الاصطناعي؟

قرصان الذكاء الاصطناعي هو شخص أو نظام شبه مستقل يستخدم الذكاء الاصطناعي لشن هجمات إلكترونية أو أتمتة البرمجيات الخبيثة أو تشغيل حملات التصيد الاحتيالي على نطاق واسع.

ما هو الذكاء الاصطناعي الذي يستخدمه مكتب التحقيقات الفيدرالي؟

يستخدم مكتب التحقيقات الفيدرالي (FBI) الذكاء الاصطناعي في فرز التهديدات والتحليل الجنائي واكتشاف الحالات الشاذة ومعالجة الأدلة الرقمية. أدوات هذه أدوات أتمتة التحقيقات وإبراز القضايا ذات الأولوية العالية مع تقليل عبء العمل على المحللين.

ما هو مثال على هجوم الذكاء الاصطناعي؟

تضمنت إحدى الحالات الواقعية رسائل بريد إلكتروني تصيدية تم إنشاؤها بواسطة الذكاء الاصطناعي خلال فترة تسجيل المزايا في إحدى الشركات. وقد انتحل المهاجمون شخصية قسم الموارد البشرية لسرقة بيانات الاعتماد. وفي حالة أخرى، ساعد الذكاء الاصطناعي في أتمتة استهداف برمجيات الفدية، مما أجبر علامة تجارية متعددة الجنسيات على إغلاق عملياتها.

ما هي الهجمات الإلكترونية للذكاء الاصطناعي؟

هجمات الذكاء الاصطناعي الإلكترونية هي تهديدات تم تطويرها أو تنفيذها بمساعدة الذكاء الاصطناعي. ومن الأمثلة على ذلك التصيد الاحتيالي الذي ينشئه الذكاء الاصطناعي، وانتحال الشخصية المزيفة، والحقن الفوري، والتهرب من التصنيف. غالباً ما تتجاوز هذه الهجمات الدفاعات التقليدية.

كيف يستخدم القراصنة والمحتالون الذكاء الاصطناعي لاستهداف الأشخاص؟

يستخدم القراصنة الذكاء الاصطناعي لإضفاء طابع شخصي على رسائل البريد الإلكتروني الاحتيالية، واستنساخ الأصوات لعمليات الاحتيال عبر الهاتف، وإنشاء مقاطع فيديو مزيفة لخداع الأهداف. تستغل هذه التكتيكات ثقة الإنسان وتجعل حتى المستخدمين المدربين تدريباً جيداً عرضة للخداع الواقعي المصمم بالذكاء الاصطناعي.

كيف يمكنني الدفاع ضد الهجمات المدعومة بالذكاء الاصطناعي؟

استخدم دفاعاً متعدد الطبقات: Multiscanning ووضع الحماية، وإنشاء صندوق الرماية، وإنشاء نظام الدفاع المضاد للقرص المضغوط، وفريق أحمر بقيادة بشرية. تتحرك هجمات الذكاء الاصطناعي بسرعة. يحتاج المدافعون إلى الأتمتة والسياق والسرعة لمواكبة ذلك.